Python爬虫包 BeautifulSoup 递归抓取实例详解

2017-01-28 11:47:41

投稿:lqh

这篇文章主要介绍了Python爬虫包 BeautifulSoup 递归抓取实例详解的相关资料,需要的朋友可以参考下

Python爬虫包 BeautifulSoup 递归抓取实例详解

爬虫的主要目的就是为了沿着网络抓取需要的内容。它们的本质是一种递归的过程。它们首先需要获得网页的内容,然后分析页面内容并找到另一个URL,然后获得这个URL的页面内容,不断重复这一个过程。

让我们以维基百科为一个例子。

我们想要将维基百科中凯文·贝肯词条里所有指向别的词条的链接提取出来。

# -*- coding: utf-8 -*-

# @Author: HaonanWu

# @Date: 2016-12-25 10:35:00

# @Last Modified by: HaonanWu

# @Last Modified time: 2016-12-25 10:52:26

from urllib2 import urlopen

from bs4 import BeautifulSoup

html = urlopen('http://en.wikipedia.org/wiki/Kevin_Bacon')

bsObj = BeautifulSoup(html, "html.parser")

for link in bsObj.findAll("a"):

if 'href' in link.attrs:

print link.attrs['href']

上面这个代码能够将页面上的所有超链接都提取出来。

/wiki/Wikipedia:Protection_policy#semi

#mw-head

#p-search

/wiki/Kevin_Bacon_(disambiguation)

/wiki/File:Kevin_Bacon_SDCC_2014.jpg

/wiki/San_Diego_Comic-Con

/wiki/Philadelphia

/wiki/Pennsylvania

/wiki/Kyra_Sedgwick

首先,提取出来的URL可能会有一些重复的

其次,有一些URL是我们不需要的,如侧边栏、页眉、页脚、目录栏链接等等。

所以通过观察,我们可以发现所有指向词条页面的链接都有三个特点:

它们都在id是bodyContent的div标签里

URL链接不包含冒号

URL链接都是以/wiki/开头的相对路径(也会爬到完整的有http开头的绝对路径)

其中getLinks的参数是/wiki/<词条名称>,并通过和维基百科的绝对路径合并得到页面的URL。通过正则表达式捕获所有指向其他词条的URL,并返回给主函数。

主函数则通过调用递归getlinks并随机访问一条没有访问过的URL,直到没有了词条或者主动停止为止。

这份代码可以将整个维基百科都抓取下来

from urllib.request import urlopen

from bs4 import BeautifulSoup

import re

pages = set()

def getLinks(pageUrl):

global pages

html = urlopen("http://en.wikipedia.org"+pageUrl)

bsObj = BeautifulSoup(html, "html.parser")

print(bsObj.h1.get_text())

print(bsObj.find(id ="mw-content-text").findAll("p")[0])

print(bsObj.find(id="ca-edit").find("span").find("a").attrs['href'])

except AttributeError:

print("This page is missing something! No worries though!")

for link in bsObj.findAll("a", href=re.compile("^(/wiki/)")):

if 'href' in link.attrs:

if link.attrs['href'] not in pages:

#We have encountered a new page

newPage = link.attrs['href']

print("----------------\n"+newPage)

pages.add(newPage)

getLinks(newPage)

getLinks("")

一般来说Python的递归限制是1000次,所以需要人为地设置一个较大的递归计数器,或者用其他手段让代码在迭代1000次之后还能运行。

感谢阅读,希望能帮助到大家,谢谢大家对本站的支持!

您可能感兴趣的文章:

Python利用 matplotlib 绘制直方图

2021-12-12

Python批量修改文件名,文件再多也只要一秒

2021-12-12

Python Matplotlib 实现3D绘图详解

2021-11-11

关于python selenium 运行时弹出窗口问题

2021-11-11

Python Pyqt5多线程更新UI代码实例(防止界面卡死)

2021-11-11

详解Python函数中的几种参数

2021-11-11

Python解压可迭代对象赋值给多个变量详解

2021-11-11

Python爬虫采集微博视频数据

2021-11-11

美国设下计谋,用娘炮文化重塑日本,已影响至中国

2021-11-19

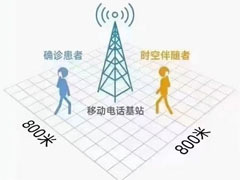

时空伴随者是什么意思?时空伴随者介绍

2021-11-09

工信部称网盘企业免费用户最低速率应满足基本下载需求,天翼云盘回应:坚决支持,始终

2021-11-05

2022年放假安排出炉:五一连休5天 2022年所有节日一览表

2021-10-26

电脑版

-

返回首页

2006-2023 脚本之家 JB51.Net , All Rights Reserved.