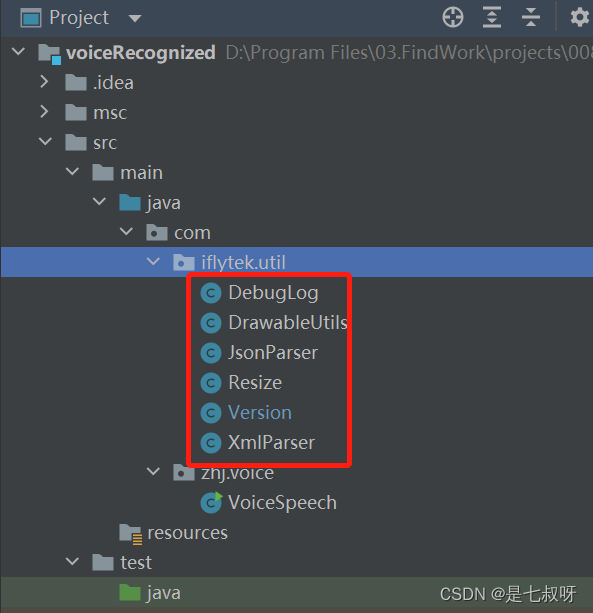

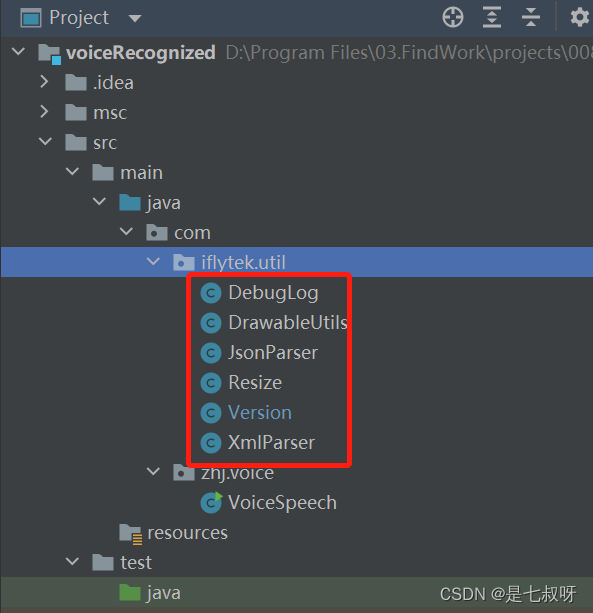

但是com.iflytek.util相关的import仍然会爆红,所以我这里是选择在com目录下手动新建iflytek.util包【使其能够手动导入】

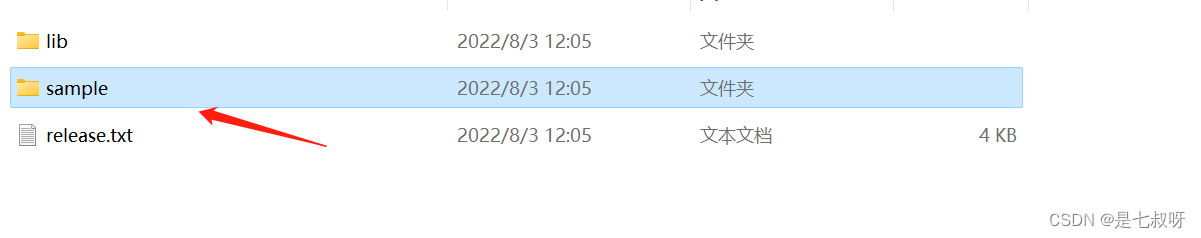

之后找到1.2步下载解压后的SDK文件夹中的sample

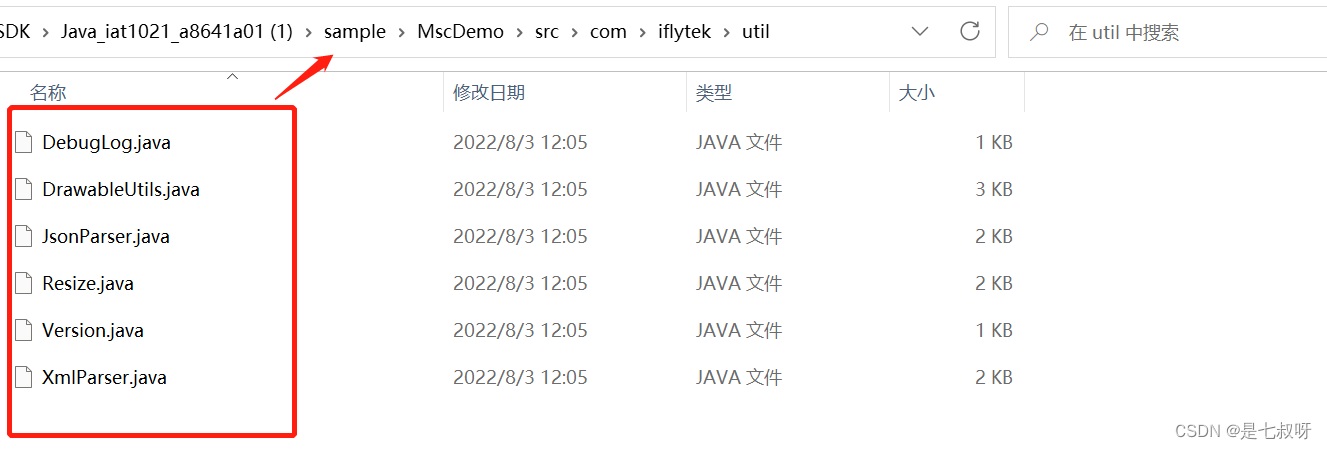

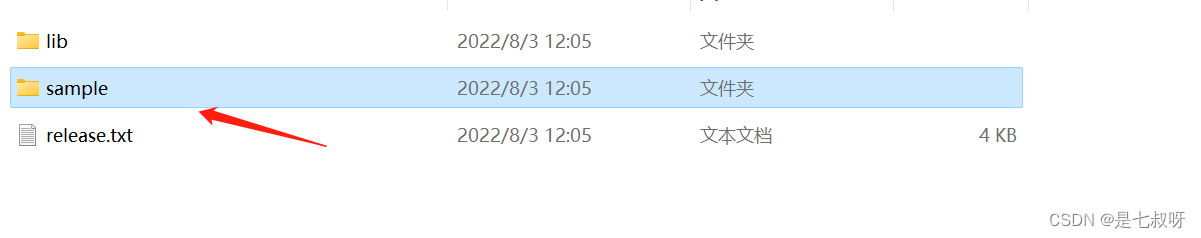

跟着目录找到sample–>src–>com–>iflytek–>util下的6个类

全选,复制粘贴到我们本地IDEA的对应包com.iflytek.util下

(这里包下Version类名中显示蓝色,是因为我已经上传到github上并且本地IDEA修改代码了,所以会显示蓝色)

这时候会发现不报错了,所有的import都正常显示了

修改com.iflytek.util.Version类中的getAppid方法返回值为我们科大讯飞官网中项目的Appid,因为返回String类型,记得Appid加双引号:

"自己的Appid号"

Appid号在1.4节的时候得到了:

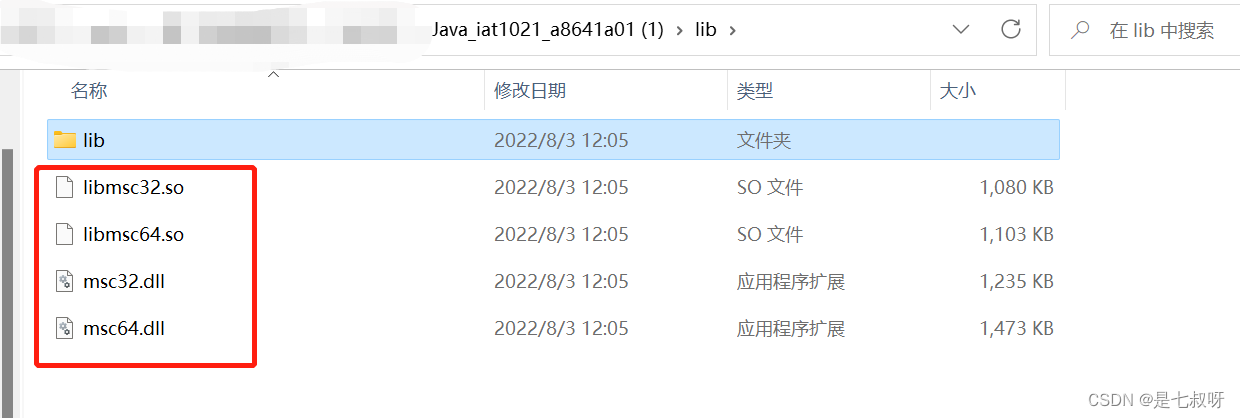

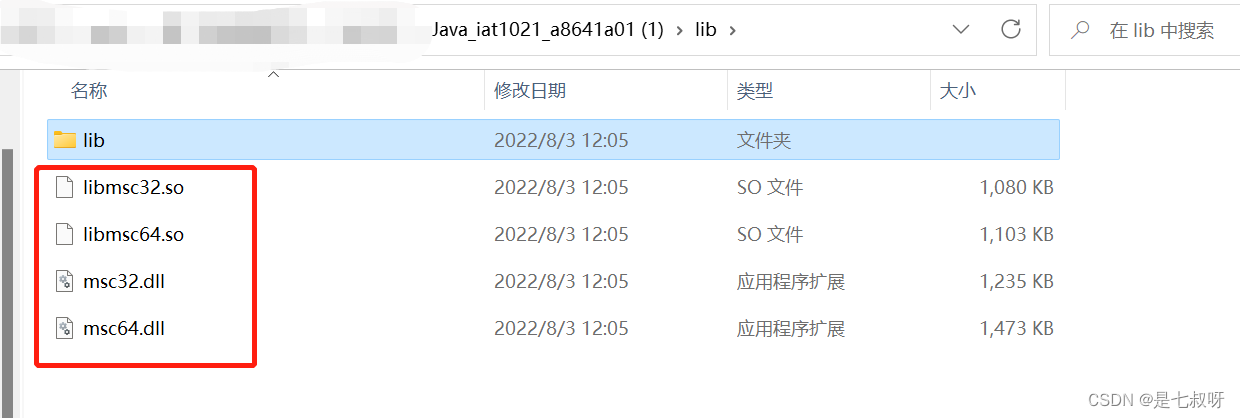

在本地下载解压好的SDK问价夹中找到lib–>lib包下的这4个文件,Ctrl+A后,Ctrl+C全选复制

然后粘贴到本地IDEA的项目根目录下就好了

至此,项目搭建就完成了。

进入VoiceSpeech类中运行main函数就可以成功启动项目且不报错了:

运行后会弹出弹框,点击start说话就可以识别到了。

识别后想要再次说话识别,点击stop后再点击start就可以了

参考:在Java中实现在线语音识别

Idea导入jar包的两种方法

科大讯飞语音识别自己写的demo,已经过自测没有问题;

1.使用前建议下载看科大讯飞的接口文档 http://doc.xfyun.cn/msc_java/299249;

MSC Develop Manual for Java.pdf

2.必须添加语音识别的jar包

语音识别功能已经是一个很普及的功能,在特定情境下,能带给人们方便的交互的体验,比如驾驶时使用语音进行唤醒手机,各类智能音响产品,语音控制智能电视等。本文主要介绍在APICloud平台使用科大讯飞的SDK快速实现语音识别功能。

一、效果预览

二、功能实现

在注册好APICloud账号后,进入控制台,添加iflyRecognition模块。iflyRecognition模块封装了科大讯飞的SDK 的语音听写、语音在线合成功能。

使用流程:

1、注册讯飞开放平台账号

2、在讯飞开放平台创建应用,并添加语音听写

运放(Operational Amplifier,简称Op Amp)是一种具有高增益、高输入阻抗、低输出阻抗、线性度高、可控制的放大器,广泛应用于电路设计中。运放可以用来放大电压、电流和信号,同时也可以用于滤波、积分、微分等运算。

运放放大器是一种基本的放大器电路,由一个运放芯片和若干个外部元件组成。在运放放大器中,运放芯片起到信号放大的作用,外部元件则用于控制运放芯片的放大倍数、输入输出阻抗等参数。

运放放大器的基本电路图如下:

其中,$V_{in}$为输入信号,$V_{out}$为输出信号,$R_1$和$R_2$组成反馈电路,$R_3$和$R_4$组成输入电路。运放芯片的输出信号将通过$R_1$和$R_2$反馈回运放芯片的输入端,从而控制其放大倍数和输出电压。该电路中,反馈电路的放大倍数将由$R_1$和$R_2$的比值决定。

运放放大器的特点:

1. 高增益:运放放大器的放大倍数非常高,可以达到几十万甚至上百万倍。

2. 高输入阻抗:运放放大器的输入阻抗非常高,可以达到几百MΩ,因此对输入信号的影响极小。

3. 低输出阻抗:运放放大器的输出阻抗非常低,可以达到几Ω,因此输出信号的稳定性非常高。

4. 线性度高:运放放大器的输入输出特性非常线性,可以保证输入信号和输出信号之间的比例关系不变。

5. 可控制:运放放大器可以通过外部电路控制其放大倍数、输入输出阻抗等参数。

运放放大器的应用:

1. 信号放大:运放放大器可以用于放大各种信号,如声音信号、光电信号、生物信号等。

2. 滤波:运放放大器可以用于滤波,如低通滤波、高通滤波、带通滤波等。

3. 积分、微分:运放放大器可以用于积分、微分等运算,如电容积分电路、电阻微分电路等。

4. 控制系统:运放放大器可以用于控制系统中的比例控制、积分控制、微分控制等。

总之,运放放大器是电路设计中非常重要的基本元件,广泛应用于各种电子设备中。

ValueError: Target size (torch.Size([4, 20, 320, 320])) must be the same as input size (torch.Size([

YOLO等目标检测模型的非极大值抑制NMS和评价指标(Acc, Precision, Recall, AP, mAP, RoI)、YOLOv5中mAP@0.5与mAP@0.5:0.95的含义

解决使用latex报错Can be used only in preamble.

CSDN-Ada助手:

YOLO等目标检测模型的非极大值抑制NMS和评价指标(Acc, Precision, Recall, AP, mAP, RoI)、YOLOv5中mAP@0.5与mAP@0.5:0.95的含义

张牙舞爪的小白π:

手把手教你使用Yolov5制作并训练自己的数据集

m0_51123425:

FCN全卷积网络理解及代码实现(来自pytorch官方实现)