一张照片就能生成视频?连口型和声音都能对上!

来源:雪球App,作者: AI研究所,(https://xueqiu.com/1615318337/128830070)

你还记得《哈利·波特》电影里,那些会动的的照片吗?

比如守卫着格兰芬多学院休息室的胖夫人——

脾气不太好的胖夫人

还有魔法界的《预言家日报》,打开报纸,新闻图片全是会动的人物,还有纪录片一样可以自动播放的事件报道。

《预言家日报》

当年看电影的时候,小智就对这些细节印象深刻。没想到这些魔法现在居然成真了!

现在,只要提供一张照片,利用神经网络技术就能实现让静止的人像动起来,甚至开口说话。

而且是 有情绪、有表情,口型跟声音完全一致的那种!

比如玛丽莲·梦露

▼原图

▼处理后的动效

你可能会说“梦露的影像资料那么多,这gif有什么好稀罕的。” 好吧,那这个怎么样呢——

▼原图

▼处理后的动效

仅凭 蒙娜丽莎 的一张平面图片就塑造出了立体动态的人物,这到底是如何实现的呢?

01

先让照片动起来

研究人员从YouTube上收集了7000张名人照片以及人脸说话视频,对机器进行训练,使其学会识别人脸上的显著特征,如眼睛、嘴巴形状、鼻梁形状等。并使用卷积神经网络创造出 动态头部模型 。

之后,再给这个训练好的模型“贴”上我们想要让它动起来的那张照片。此时,系统能够自己找到对应的五官部分,然后针对新面部里各个的关键点进行调整,最后达到自然的动态效果。

此时,即使只有一张目标照片,也能进行人脸模拟。当然,照片的数量越多,最终视频也会越加精致和逼真。

1张、8张、32张目标人物的照片的训练结果

研究人员表示“尽管需要调整数千万的参数,该系统能够因人而异地初始化生成器和判别器参数。因此,训练可以在仅借助几幅图像的情况下快速完成”。

02

加上声音对口型

OK,让静态照片动起来的操作已经完成了,现在再配上音频就能完成了。

不过这“配音”的步骤可没有那么简单。

如果只是简单粗暴地把音频加到做好的视频上,结果就会变成咱们小时候看的粗糙动画片: 卡通人物不管在说啥,嘴巴永远只有“开”“合”这两个动作——

光看口型,你知道海绵宝宝说了什么吗?

小时候从来都没质疑过人物口型为啥跟台词对不上的朋友,请到这里集合······

成年人的视觉对脸部细节的敏感程度比小孩子要高得多 ,要不然也不会出现明星因为口型对不上被观众逮到假唱的糗事了。

因此,在不久前举办的计算机视觉顶会CVPR 2019 上,这项新研究提出了一个端到端系统。在之前研究的基础上,不仅实现了人物口型和音频的同步,还实现了更为自然的人物面部表情,比如眨眼和眉毛动作等。

新合成视频中人物的情绪饱满

这才是“jpg→gif→mp4”的全过程。

03

仍有些粗糙

虽然以上的实验成果已经非常惊艳了,但细看之下,仍可以发现不少bug。

例如,正常人说话时会有轻微的头部运动。但实验合成的一些人物头部转动时, 五官和脸型会发生变形 ,有种说不出的怪异感。

又比如一些人物 背景会发生扭曲

而图灵测试的结果也反应,大众并没有那么容易被合成的假视频欺骗。

【什么是图灵测试?】

图灵测试是由“计算机科学之父”艾伦·麦席森·图灵提出的关于机器人的著名 判断原则 。

如果说现在有一台机器人,其运算速度非常快,可以进行听说读写,还能回答许多问题。那么,我们是否就能说这台机器人具有思维能力了呢?

我们可以进行这样的测试:将测试者与被测试的机器人隔开的,测试者通过一些装置(如键盘)向被测试者提出一些问题。几轮问答后,如果测试者能正确分辨出被测试对象中哪些是真人、哪些是机器人,那机器就没有通过图灵测试;反之,若测试者没能判断出来,那这个机器就可以被认为是有人类智能的。

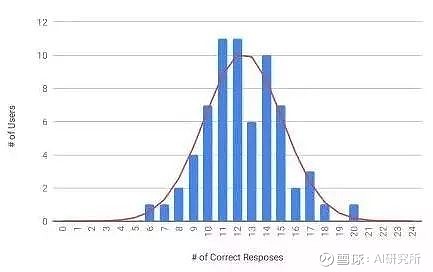

在对本项目进行的图灵测试中,66名测试志愿者需要观看 24 个视频(12 个真实视频,12 个合成视频),并且将每个视频标注为“真”或“假”。测试结果表明,平均用户标注的正确率为 52%。

总的来说,模型的动作幅度越大、速度越快,目标照片的背景元素越复杂,产生的怪异感和形变就会越严重;而视频时间越长,观众容易发现漏洞的概率也会越大。

04

技术应用

单张或少量照片就能完成动态人像,这样的速度和效率让该模型更利于推广。可以预测,未来这一系统将会被应用在游戏、电视、电影特效行业中。

例如好莱坞的许多大型数字特效公司,利用现有技术将一位演员的面容“移植”到另一个身体上,需要花费几个月的时间。而使用这样的技术,可以大大缩短制作时间,节省成本。

特效电影《阿凡达》就花费了大量的后期制作时间

当然,也有不少网友表示,一些演技堪忧的流量明星这下可有救了。

此外,这一技术还可应用于特殊人物的 “复活” 。例如,在佛罗里达州的圣彼得堡,达利博物馆就将著名的超现实主义画家达利“复活”了。

在这场名为《Dalí Lives》的展览上,展品是一个显示屏,上面有一个按钮,当你摁下按钮时,屏幕里的达利仿佛听到了门铃声,会走过来和你说话,让人感觉非常真实。

而这一展览使用的,就是机器学习驱动的视频编辑技术。

预测将来,这一技术还可以成为私人化定制服务,满足客户将名人或过世的亲人“复活”的需求。

而此刻正在B站刷视频的小智,产生了一个大胆的想法——是时候用AI技术为鬼畜区添砖加瓦了。

B站全明星阵容,敬请期待

而点开微信表情包,我又产生了一车大胆的想法——

让你的照片动起来 !

想让你的照片动起来吗?jpg秒变gif,甚至可以配上声音变成视频哦。这里有一款简易的小程序可供大家体验!

作品示例

获取步骤:

1.转发本文到朋友圈并将 截图 发送到AI研究所后台;

2.再发送关键词“ 动态 ”到后台。

我们确认过后,就会将小程序推送给你!

编辑:Sue

图片来源于网络,版权归原作者所有,如有侵权请联系删除

觉得技术很赞,一起点个在看!