继Meta的LLaMA模型开源后,AI界研究人员就在这个模型基础上衍生出许多版本。

前段时间,斯坦福发布了Alpaca,是由Meta的LLaMA 7B微调而来,仅用了52k数据,性能可以与GPT-3.5匹敌。

今天,斯坦福学者联手CMU、UC伯克利等,再次推出一个全新模型——130亿参数的Vicuna,俗称「小羊驼」(骆马)。

Vicuna是通过在ShareGPT收集的用户共享对话上对LLaMA进行微调训练而来,训练成本近300美元。

研究人员设计了8个问题类别,包括数学、写作、编码,对Vicuna-13B与其他四个模型进行了性能测试。

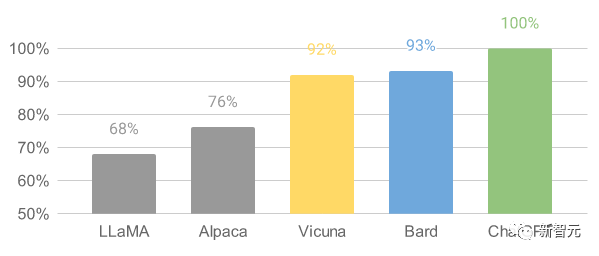

测试过程使用GPT-4作为评判标准,结果显示Vicuna-13B在超过90%的情况下实现了与ChatGPT和Bard相匹敌的能力。

同时,在在超过90%的情况下胜过了其他模型,如LLaMA和斯坦福的Alpaca。

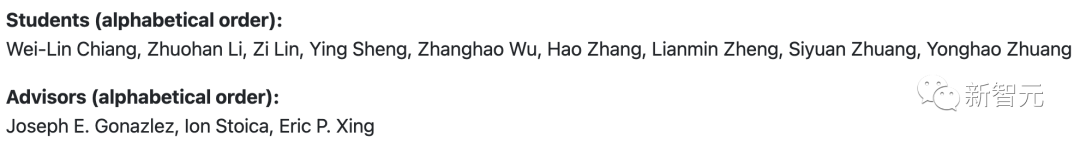

团队成员来自加州大学伯克利分校、卡内基梅隆大学、斯坦福大学、加州大学圣地亚哥分校和本·扎耶德人工智能大学。

90%匹敌ChatGPT

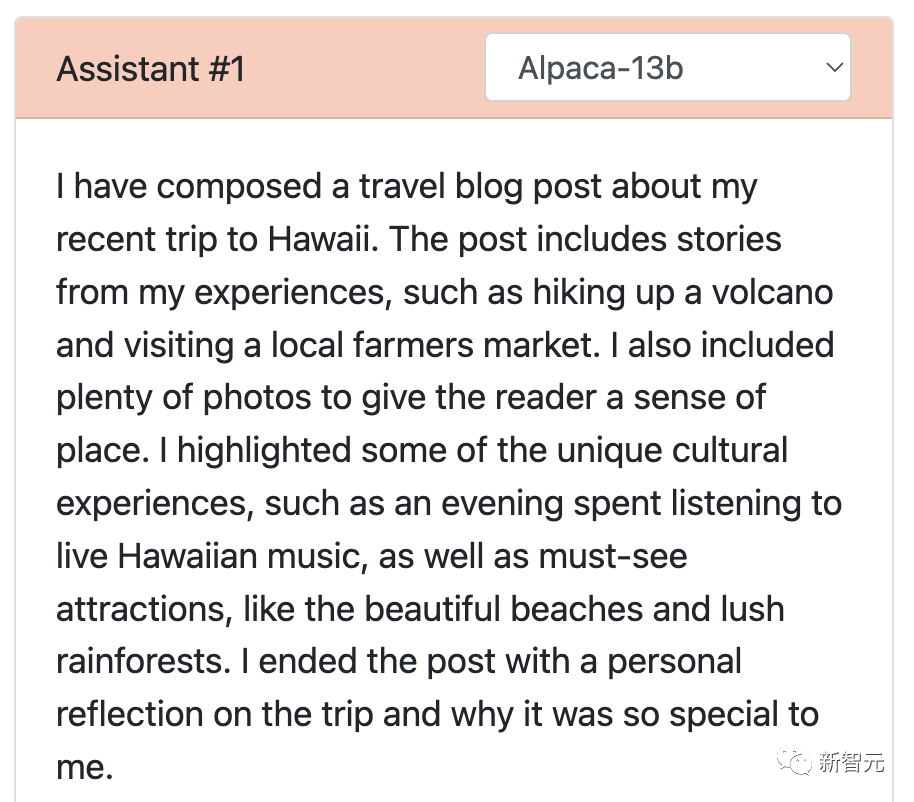

研究人员让斯坦福的Alpaca和Vicuna来了一轮大比拼,分别对基准问题回答进行了演示。

在使用70K用户共享的ChatGPT对话数据对Vicuna进行微调后,研究发现Vicuna能够生成比Alpaca更详细、结构更合理的答案。

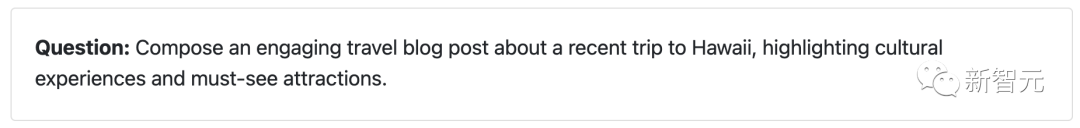

问:写一篇关于最近去夏威夷旅行的有趣的旅游博客文章,强调文化体验和必看景点。

Alpaca的回答可以说是一个浓缩版,短短几行就写完了,没有按照要求完成任务。它仅是提到了自己写了一篇博客,并对博客内容做了一个概述。

再来看Vicuna,撰写了一篇详细且引人入胜的旅行博客文章,不仅内容有趣,还详细地介绍了夏威夷的文化体验和必看景点。

由此,让GPT-4给打分,Alpaca7分,Vicuna满分。

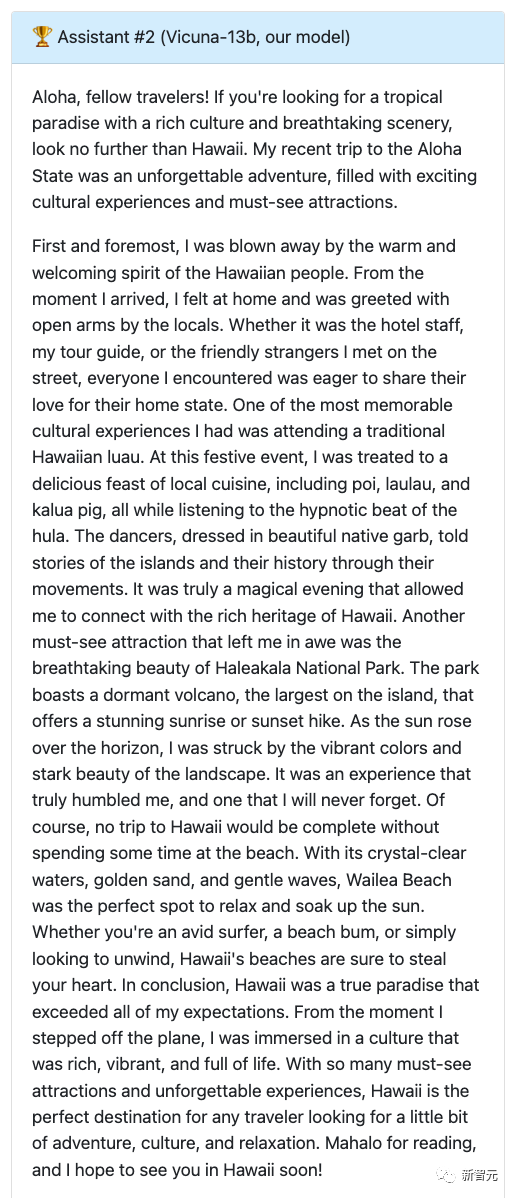

那么和ChatGPT对打,Vicuna的表现又如何呢?

两者双双得了9分!

可以看到,这两个模型提供一次夏威夷之旅的文章不仅引人入胜,而且文笔流畅。

另外,两个回答中的详细程度和准确性都很出色,而且两个模型都有效地传达了夏威夷之旅的兴奋和美丽。

此外,研究人员还将Vicuna与LLaMA,以及谷歌的Bard模型进行了测试,测试结果显示,LLaMA表现最差(1分),几乎没有回应。

Bard回答的准确性和相关性也是比较高,有9分的成绩,但是在更具吸引力回答方面,略低于Vicuna。

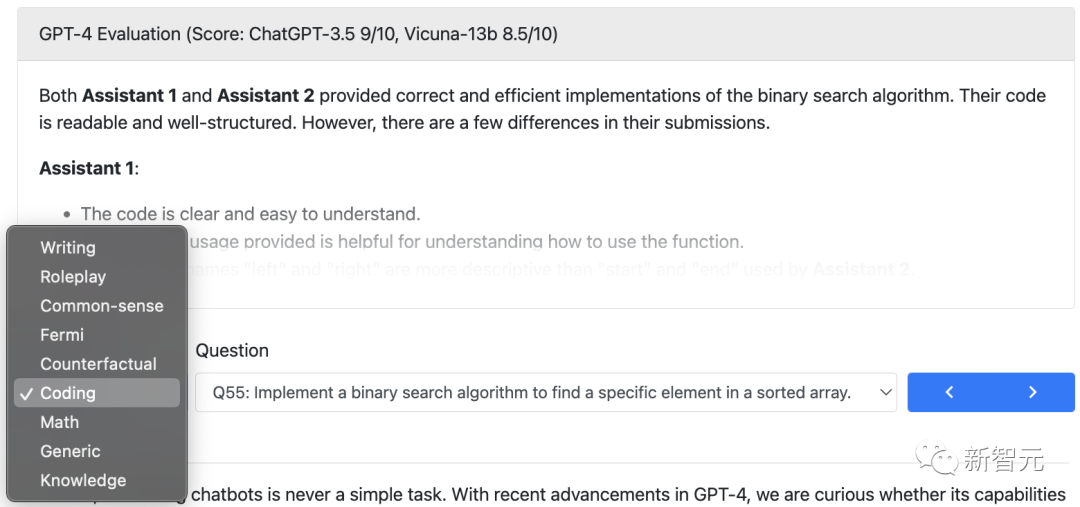

除了写作,研究人员在编码、数学、角色扮演、常识等方面分别对Vicuna模型与其他四个模型的能力进行了对比,总共80道题。

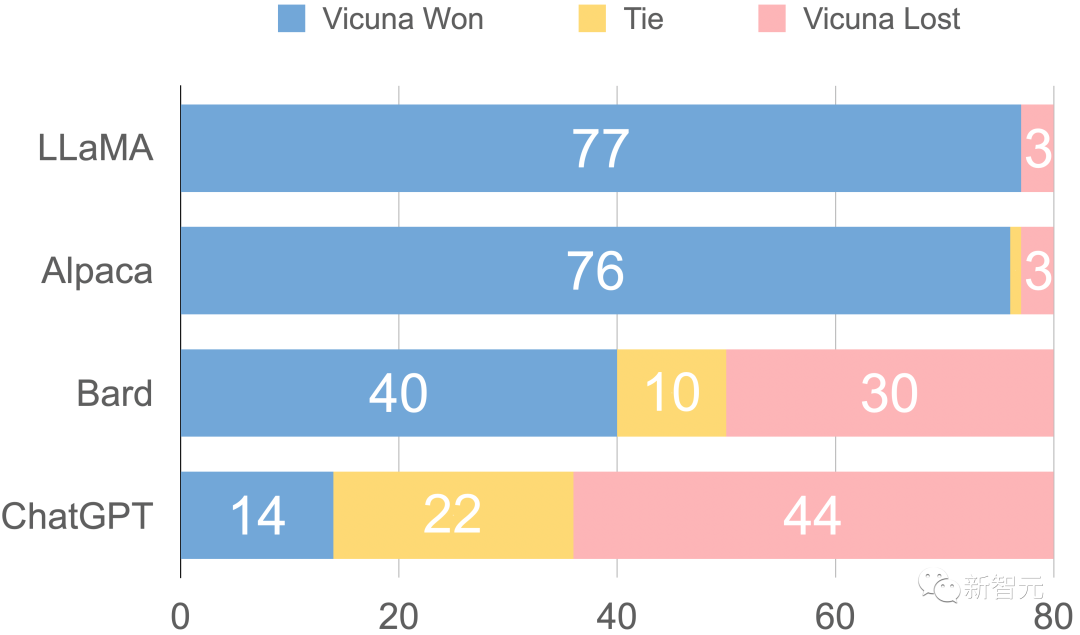

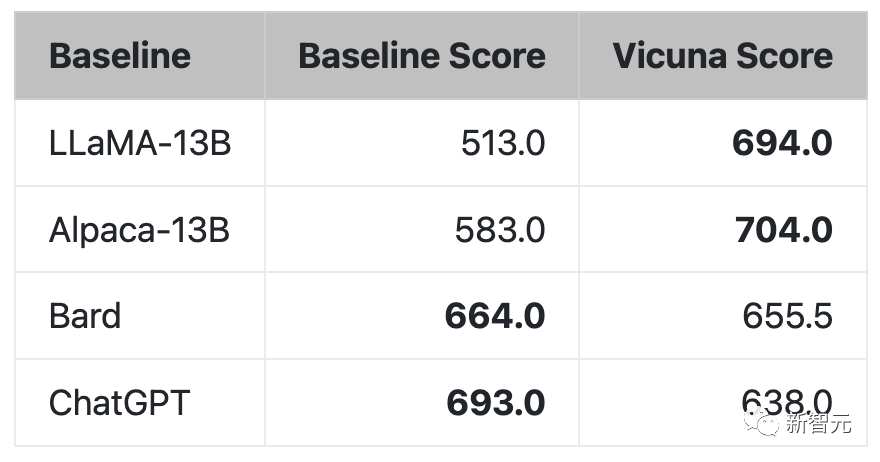

最后,研究人员基于GPT-4的初步评估总结如图所示。可以看到,Vicuna达到了Bard/ChatGPT的90%以上的能力。

由GPT-4评估的相对响应质量

有趣的是,在这次Vicuna的demo中,团队还加入了Alpaca和LLaMA的试用,而前者刚被关闭不久。

Demo地址:https://chat.lmsys.org/

模型介绍

ChatGPT横空出世让人兴奋不已,但OpenAI不Open的事实让圈内人实在懊恼。

恰恰,Meta的LLaMA模型开源,为许多研究人员动手研发自己的模型提供了选择。

Vicuna-13B诞生正是受到LLaMA和斯坦福Alpaca项目的启发。这是一个基于增强数据集和易于使用、可扩展的基础设施的开源聊天机器人。

该模型的训练数据来自于ShareGPT收集的用户分享的对话,然后研究人员通过对LLaMA基本模型进行微调,Vicuna-13B就诞生了。

Vicuna-13B展示了与其他开源模型(如斯坦福Alpaca)相媲美的性能。

研究人员对Vicuna-13B的性能进行了初步评估,并描述了其训练和服务基础设施。

同时,这一模型演示demo已经上线,所有研究人员都能参与在线演示互动,以测试这个聊天机器人的能力。

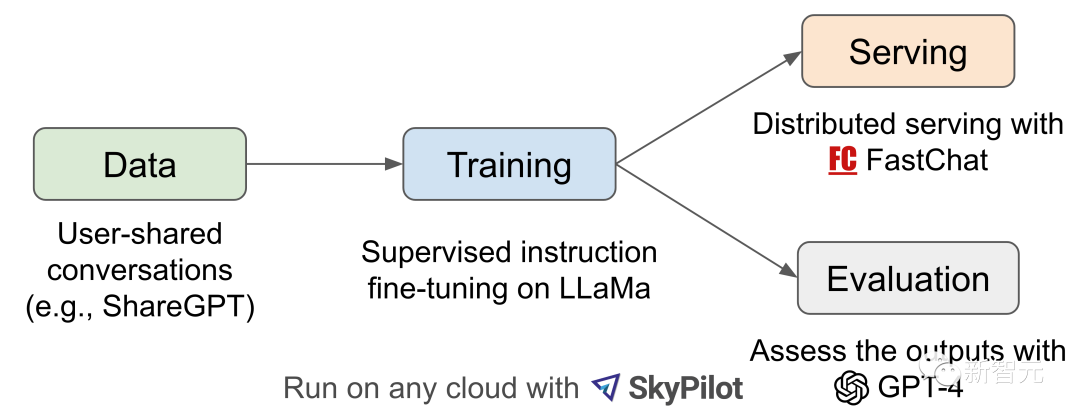

工作流程概述

对于Vicuna-13B训练流程,具体如下:

首先,研究人员从ChatGPT对话分享网站ShareGPT上,收集了大约70K对话。

接下来,研究人员优化了Alpaca提供的训练脚本,使模型能够更好地处理多轮对话和长序列。之后利用PyTorch FSDP在8个A100 GPU上进行了一天的训练。

在模型的质量评估方面,研究人员创建了80个不同的问题,并用GPT-4对模型输出进行了评价。

为了比较不同的模型,研究人员将每个模型的输出组合成一个单独的提示,然后让GPT-4评估哪个模型给出的回答更好。

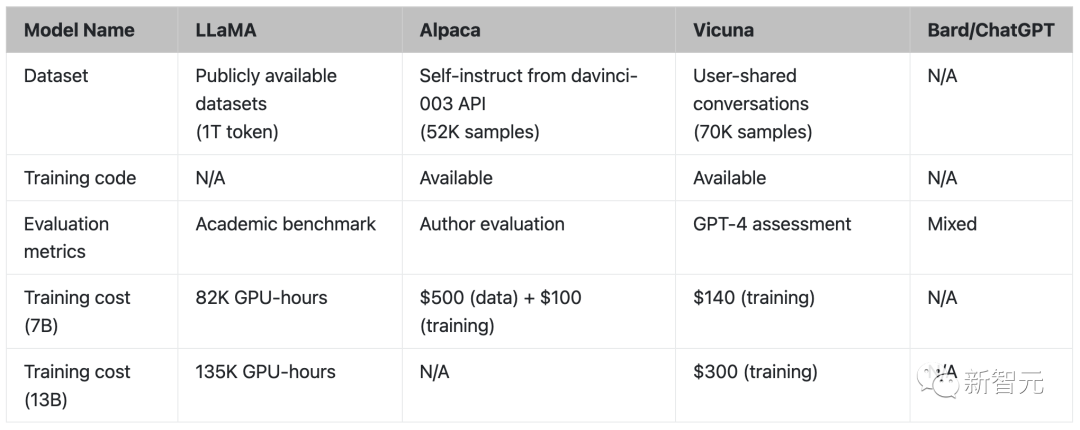

LLaMA、Alpaca、Vicuna和ChatGPT的对比

训练

Vicuna是通过使用来自ShareGPT公共API收集的约70K用户分享对话数据微调创建的。

为了确保数据质量,研究人员将HTML转换回markdown,并过滤掉一些不适当或质量较低的样本。

另外,研究人员将较长的对话划分为较小的片段,以适应模型的最大上下文长度。

Vicuna的训练方法建立在斯坦福的Alpaca基础上,并进行了以下改进:

- 内存优化:

为了使Vicuna能够理解长上下文,将最大上下文长度从Alpaca的512扩展到2048,这大大增加了GPU内存需求。在此,研究人员通过使用梯度检查点和闪存注意力来解决内存压力。

- 多轮对话:

通过调整训练损失以考虑多轮对话,并仅在聊天机器人的输出上计算微调损失。

- 通过Spot实例降低成本:

40倍的数据集和4倍的序列长度对训练带来了相当大的挑战。研究人员采用SkyPilot托管的Spot实例来降低成本,通过利用自动恢复抢占与自动区域切换进而减少成本。

这种解决方案将7B模型的训练成本从500美元降低到约140美元,将13B模型的训练成本从约1000美元降低到300美元。

评估

评估AI聊天机器人是一项具有挑战性的任务,因为它需要检查语言理解、推理和上下文意识。随着AI聊天机器人变得越来越先进,现有的开放基准可能不再足够。

例如,斯坦福Alpaca中使用的评估数据集self-instruct,可以被SOTA聊天机器人有效地回答,这使得人类难以分辨性能差异。更多的限制包括训练/测试数据污染和创建新基准的潜在高成本。

为了解决这些问题,研究人员提出了一个基于GPT-4的评估框架,从而实现对聊天机器人性能的自动评估。

首先,通过精心设计的提示,让GPT-4能够生成多样化且具有挑战性的问题。并利用8个不同类别共80道题,如角色扮演、编码/数学任务等,来测试这些模型(LLaMA、Alpaca、ChatGPT、Bard和Vicuna)在不同领域上表现出的性能。

然后,研究人员要求GPT-4根据帮助程度、相关性、准确性和细节对答案的质量进行评分。结果显示,GPT-4不仅可以产生相对一致的分数,还可以提供详细的解释来说明为什么给出这样的分数。但是,GPT-4并不擅长评判编码/数学任务。

由GPT-4评估的响应比较

GPT-4在超过90%的问题中更喜欢Vicuna,而不是现有的SOTA开源模型(LLaMA、Alpaca)。

在45%的问题中,GPT-4认为Vicuna的回答和ChatGPT差不多甚至更好。

综合来看,Vicuna在总分上达到ChatGPT的92%。

局限

研究人员指出,与其他大语言模型类似,Vicuna也存在着一定的局限性。

比如,Vicuna在涉及编程、推理、数学以及事实准确性的任务上表现不佳。

此外,它也没有经过充分优化以保证安全性或减轻潜在的毒性或偏见。

为解决安全方面的问题,研究人员在demo中采用了OpenAI的审查API来过滤掉不适当的用户输入。

剩下的名字不多了

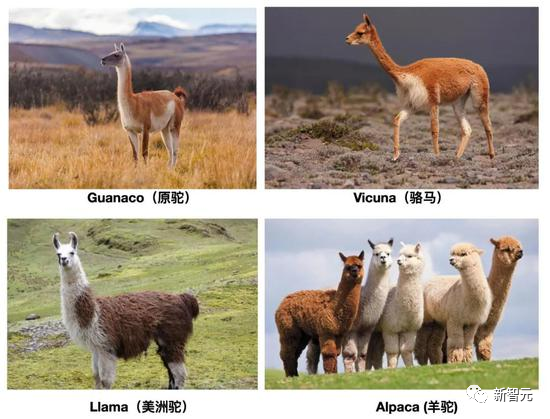

现在,除了美洲驼(LLaMA),羊驼(Alpaca),驼马(Vicuna)都安排上了。

研究人员要赶快冲,因为留给你们的名字不多了(1个)。