df1 = data.groupby('year').size()

line = Line()

line.add_xaxis(xaxis_data=df1.index.to_list())

line.add_yaxis('',y_axis=df1.values.tolist(),is_smooth = True)

line.set_global_opts(xaxis_opts=opts.AxisOpts(splitline_opts = opts.SplitLineOpts(is_show=True)))

line.render_notebook()

本次实验通过使用爬虫获取2016年-2023年的电影数据,并可视化分析的得出以下结论:

1.2016年-2019年电影数量逐渐增大,2019年达到最大值,从2020年开始迅速逐年下降。

2.发布电影数量最多的国家是中国和美国。

3.电影类型最多的剧情片。

4.电影片长呈正态分布,且片长和评分呈正相关关系。

最后,给大家分享一份Python学习资料,都是我自己学习时整理的,希望可以帮到你!Python是一门非常不错的编程语言,就业前景好、薪资待遇高。可以应用于爬虫、web前端开发、后端开发、数据分析、人工智能、自动化测试等领域。即使你不想出去上班,也可以利用Python在家做兼职赚钱(比如爬取客户需要的数据、量化交易、代写程序等)。 是不是非常不错呢?

资料包括:Python安装包+激活码、Python web开发、Python爬虫、Python数据分析、Python自动化测试、人工智能等学习教程。0基础小白也能听懂、看懂!

一、Python所有方向的学习路线

Python所有方向路线就是把Python常用的技术点做整理,形成各个领域的知识点汇总,它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。

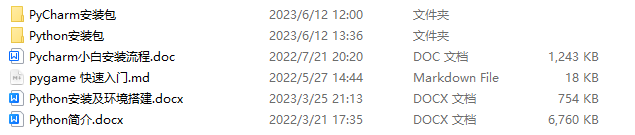

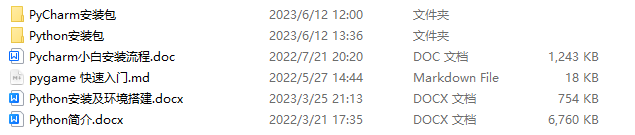

二、Python学习软件

学习Python常用的开发软件都在这里了!每个都有详细的安装教程,保证你可以安装成功哦!

三、Python入门学习视频

还有很多适合0基础入门的学习视频,有了这些视频,轻轻松松上手Python~

四、Python实战案例

光学理论是没用的,要学会跟着一起敲代码,动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。100+实战案例源码等你来拿!

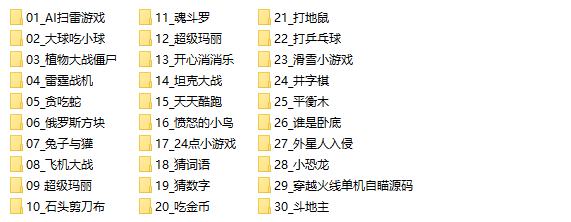

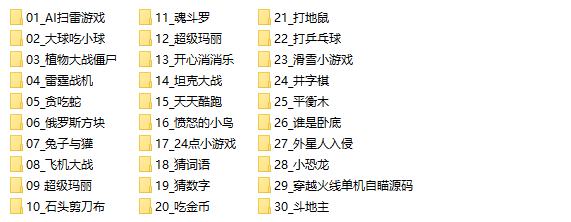

五、Python小游戏源码

如果觉得上面的实战案例有点枯燥,可以试试自己用Python编写小游戏,让你的学习过程中增添一点趣味!

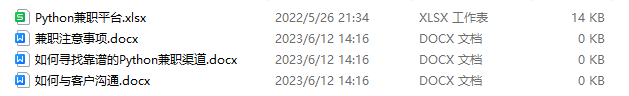

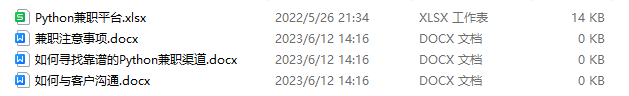

六、副业兼职

而且学会Python以后,还可以在各大兼职平台接单赚钱,各种兼职渠道+兼职注意事项+如何和客户沟通,我都整理成文档了。

七、资料领取

由于篇幅有限,很多资料图片放不上来。需要的小伙伴可以微信扫描下方CSDN官方认证二维码领取(免费免费免费)

本次实验通过使用爬虫获取2016年-2023年的电影数据,并可视化分析的得出以下结论:1.2016年-2019年电影数量逐渐增大,2019年达到最大值,从2020年开始迅速逐年下降。2.发布电影数量最多的国家是中国和美国。3.电影类型最多的剧情片。4.电影片长呈正态分布,且片长和评分呈正相关关系。最后,给大家分享一份Python学习资料,都是我自己学习时整理的,希望可以帮到你!Python是一门非常不错的编程语言,就业前景好、薪资待遇高。

Python爬虫获取疫情数据,利用Flask+Echarts对数据进行分析与多样化展示。

Python + Flask + Echarts制作的新冠肺炎疫情实时监控项目,完成的功能主要有:

1、统计全球各国疫情数据

2、统计全国各省市地区每日疫情数据,并以图表形式展现

3、统计全国疫情历史数据,并以图表形式展现

4、统计百度热搜数据,并以词云图形式展现

里面有具体的使用说明和爬虫笔记,使用的是mysql数据库,有完整的数据库文件,可直接下载使用。

基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统基于python的影评数据爬取和分析系统

在 基于爬虫+Flask实现豆瓣

电影Top250

数据分析 的基础上,进一步实战,

开发出本项目 基于爬虫+Flask实现的招聘岗位

数据分析与

可视化,干货多多,也学到了很多的东西。

文章目录1、项目简介:2、成果展示:3、后台展示4、项目总结:

1、项目简介:

项目主要是对招聘网站 51job 上的招聘信息进行

爬取,存放到 sqlite

数据库,采用 Flask 框架与前台交互,使用 Echarts 框架实现对

数据的

可视化分析,wordCloud 制作词云,精彩多多,Go。

2、成果展示:

1、进入此次爬取的页面点这里。2、按F12—> network3、ctrl+r 刷新 如图搜索一个电影名,找到数据位置,然后查看4、找到请求的url ‘?’后边的是参数,不要带上5、参数单独拿出来start:0 代表的是排行榜的第一部电影limit:20 代表的是一次返回20条数据(20部电影)start和limit都可以更改6、大致先看一看拿到的数据类型,然后解析,从其中拿到自己想要的数据 7、开始编写代码:

运行代码,查看结果: 拿到的的确是两条数据,然后从其中选择自己想要的数据出来,进行可视

### 回答1:

Python是一种简单易学的编程语言,适合数据处理和分析。在爬取天气数据方面,Python有很多强大的第三方库可以帮助我们完成这项任务。

首先,我们可以使用BeautifulSoup库或Scrapy爬取天气网站上的数据。这些库可用于将HTML网页转换为Python对象,从而轻松地提取数据。

然后,我们可以使用pandas库将爬取的数据存储在DataFrame中,并对其进行有效的处理和分析。pandas提供了各种数据操作方法,例如连接、过滤、排序和分组,使我们能够有效的清理和整理数据。

最后,我们可以使用matplotlib或Seaborn等可视化库来创建数据可视化图表。这些库提供了各种绘图选项,例如折线图、散点图等,使我们能够更好地理解和分析数据。

总结来说,从爬取到处理再到可视化分析,Python提供了完整的工具链,使我们可以轻松地获取所需信息、分析数据并推出结论。

### 回答2:

Python是一门非常适合进行数据爬取和数据分析的语言。如果想要实现爬取天气数据并进行可视化分析,可以使用Python的第三方库进行实现。下面我们来详细介绍一下具体的步骤。

首先,我们需要选择合适的天气数据来源。在国内,有很多天气网站提供了API接口供开发者使用。例如,中国天气网、天气之子等等。我们可以选择其中一个合适的接口进行数据爬取。比如,我们可以爬取每天的温度、湿度、风力等信息,并将其存储到本地的数据库中或者保存为csv、txt等格式的文件。

接下来,我们需要将爬取到的天气数据进行可视化分析。这里我们可以使用Python的matplotlib库,它是一个非常强大的数据可视化工具。我们可以通过调用该库中的函数,绘制出各种类型的图表,如折线图、柱状图、散点图等等。具体的绘图方法,可以根据我们需要展示的信息以及分析目的,灵活选择。

最后,我们可以将经过可视化分析的数据图表进行可视化展示。Python提供了很多可视化库,比如Flask、Django等,可以将分析结果以Web页面的形式展现出来。另外,还可以使用Jupyter Notebook进行编程和可视化的交互式展示。

总之,通过Python进行天气数据的爬取和可视化分析,可以帮助我们更加全面、直观地了解天气情况,并从中发现有用的规律和趋势。而本文所提到的方法只是其中的一种,还有很多其他的可视化工具和数据分析思路,需要根据具体情况进行选择和应用。

### 回答3:

Python 是一种非常强大的编程语言,可用于爬取数据和可视化分析。在这里,我们将介绍如何使用 Python 爬取天气数据,并对其进行可视化分析。

1. 爬取天气数据

爬取天气数据的第一步是确定数据源。一些常见的数据源包括:天气预报和气象站数据。我们可以使用 Python 程序访问这些数据源,然后将其存储在 CSV 文件中。

以下是使用 Python 爬取天气数据的简单步骤:

- 导入所需的库:如requests、beautifulsoup4、csv等库;

- 定义爬取的网址:通过查看天气预报或气象站来确定要爬取的网址;

- 解析网页:使用BeautifulSoup库来解析HTML源代码;

- 提取数据:从HTML源代码中提取所需信息(例如,温度、湿度、气压等);

- 存储数据:利用Python的csv库将提取的数据存储在CSV文件中。

2. 可视化分析

Python还提供了各种库和工具,可对爬取的天气数据进行可视化分析。下面是一些常用的库和工具:

- Matplotlib:用于绘制图表和可视化;

- Pandas:用于加载和预处理数据;

- Seaborn:用于数据可视化和统计;

- Plotly:用于交互式绘图;

- Bokeh:用于高级交互式可视化。

可视化分析的步骤如下:

- 导入所需的库;

- 加载数据:从CSV文件中加载爬取的天气数据;

- 预处理数据:通过排序、过滤和合并数据等方式,为可视化做准备;

- 绘图:根据需要,使用Matplotlib、Seaborn、Plotly和Bokeh等库来绘制图表;

- 交互:使用Plotly和Bokeh等库创建交互式可视化。它们提供了各种控件,例如滑块、下拉菜单、复选框和单选按钮,以便用户能够自定义图表。

总之,使用Python爬取天气数据并进行可视化分析是一项有用的技能,使您能够更好地理解天气变化和趋势。