使用正交随机森林与因果森林进行因果推断的用例文章。

参考:

[1]Oprescu M , Syrgkanis V , Wu Z S . Orthogonal Random Forest for Causal Inference[J]. Papers, 2019.

[2]Oprescu M , Syrgkanis V , Wu Z S . Orthogonal Random Forest for Heterogeneous Treatment Effect Estimation[J]. Vasilis Syrgkanis, 2018.

[3]Wager S, Athey S. ,2018,“Estimation and Inference of Heterogeneous Treatment Effects using Random Forests”, Journal of the American Statistical Association, 113:523,1228-1242.

大数据因果推断-正交随机森林和因果森林

1 仿真 & 结果

1.1 数据生成

1.2 训练估计器

1.3 结果可视化

2 实际数据 & 结果

2.1 数据描述

2.2 训练估计器

2.3 结果

因果森林和广义随机森林是一种估计随机森林处理效果异质性的灵活方法。 正交随机森林(ORF)与广义随机森林结合使用正交化技术,该技术可有效消除两阶段估计中的混淆效应。 由于该方法的正交化方面,ORF在存在高维混杂因素的情况下表现尤其出色。

因果推断(causal )是计量经济学最核心的问题之一。传统上,大多数因果推断的应用数据量比较小,对于异质性的讨论不够充分,而现在越来越多的应用开始潜在的对个体的处理效应进行估计。

使用异质性处理效用的一个担心是,一些研究者可能会去寻找那些处理效应比较强的个体,并只报告这些个体的结果。为了解决这些问题,Athey和Imbens在去年JASA的文章中给出了一个基于决策树和随机森林的解决方案,或称因果森林。

该方法本质上是一个非参数的方法。与传统非参数方法,比如临近匹配、基于kernel的方法等相比,该方法具有一个优势即该方法没有『维数诅咒』的问题,而传统方法当变量的维数增加时效果会大打折扣。

当然,没有推断就没有因果推断。决策树、随机森林是机器学习中常用的算法,然而机器学习通常而言重视预测结果而非推断。本文的另一贡献在于,在将随机森林算法与因果推断相结合的同时,给出了估计量的渐进分布和构造置信区间的方法。

决策树是机器学习中常用的算法,该算法使用了一种层级的结构:树,来帮助预测。

其中中间的层次成为节点,而最终的节点我们一般成为「叶」。

以分类问题为例,决策树通常使用递归的方法一层一层的将数据分解为不同的子样本,比如在上图的树中,每个节点都代表一个子样本,为了继续让树增长,需要一个指标度量下一步如何分组才能使得两个分类更能被区分开。比如,C4.5算法使用熵增作为标准,而CART算法使用基尼系数作为标准。CART算法不仅仅可以做分类,还可以做回归,其最终的结果是一个二叉树。由于这些特性,本文使用了CART算法。

在决策树的基础之上,还可以进一步做随机森林(Random forest),即首先使用Bootstrap的想法有放回的在数据中抽样,同时抽取特征(自变量X)的一个子集,进行决策树的预测。以上步骤可以不断重复,形成很多很多决策树,最终的决策结果由所有这些决策树的投票产生。在实践中,随机森林的分类效果通常非常理想。

可参考上述文献。

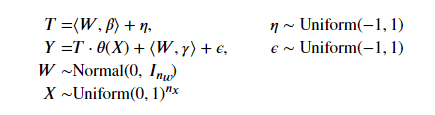

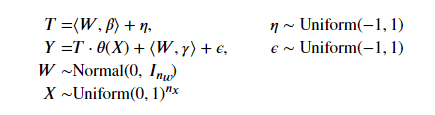

这里,我们使用数据生成过程(DGP)。 DGP由以下方程式描述:

𝑊是高维混杂因子的矩阵,而𝛽,𝛾具有高度稀疏性。在本GDP过程中:

θ x = exp ( 2 × x 1 ) \theta_{x} = \exp(2\times{x_{1}})

θ

x

=

exp

(

2

×

x

1

)

np.random.seed(123)

n = 1000

n_w = 30

support_size = 5

n_x = 1<

因果推断(causal )是计量经济学最核心的问题之一。传统上,大多数因果推断的应用数据量比较小,对于异质性的讨论不够充分。本文对正交随机森林与因果森林进行介绍。并将算法应用于芝加哥大学布斯商学院提供的商店级橙汁价格和销售额的流行历史数据集,得到治疗结果的90%置信区间。

Python

中基于

机器学习

的

因果

推理/提升

内容: •••

causeinfer是一个

Python

软件包,用于使用

机器学习

来估计平均和条件平均处理效果。 它的目标是编译标准和高级的

因果

推理模型,并展示其用法和功效-所有这些都具有帮助人们在商业,医学和社会经济领域学习CI技术的总体雄心。 请参阅以获取该软件包的完整概述,包括模型和数据集。

causeinfer可以通过pip从PyPI下载或直接从此存储库中获取:

pip install causeinfer

git clone https://github.com/andrewtavis/causeinfer.git

cd causeinfer

python

setup.py install

import causeinfer

因果

推理算法

两种模型方法

对治疗和对照组的单独模型进行了训练和组合,以得出平均治疗效果(Hanso

近年来,

因果

推断

逐渐成为了

机器学习

中的热点话题。增益模型(Uplift Model)作为工业界

因果

推断

与

机器学习

结合最成熟的算法之一,在智能营销中有着广泛的应用。但是目前大多数增益模型仅讨论了二元处理变量情况下的处理效应估计,然而在网约车市场中存在大量多维、连续的处理变量。针对这一困境,我们构造了连续

因果

森林

模型,并成功地应用在了网约车交易市场策略上。

在网约车供需策略技术基础能力团队,我们最关注的工作之一就是量化价格对网约车供需关系的影响。这对于精细化定价补贴策略的制定和优化有着重要的.

森林

顾名思义就是有很多树,这里的树当然就是

决策树

。实际上

随机森林

就是将 fully-grown C&RT decision tree 作为 bagging 基模型(base model)。

random forest (RF) = bagging + fully-grown C&RT decision...

利用

随机森林

选择特征可参看论文Variable selection using Random Forests。

用

随机森林

进行特征重要性评估的思想其实很简单,说白了就是看看每个特征在

随机森林

中的每颗树上做了多大的贡献,然后取个平均值,最后比一比特征之间的贡献大小。

好了,那么这个贡献是怎么一个说法呢?通常可以用基尼指数(Gini i...